最近看到一条帖子,主题很抓人:一个 Plus 账号不够用,一个 Pro 账号又经常闲着,于是用 CLIProxyAPI 把多个账号组成本地代理池给 Codex 用。

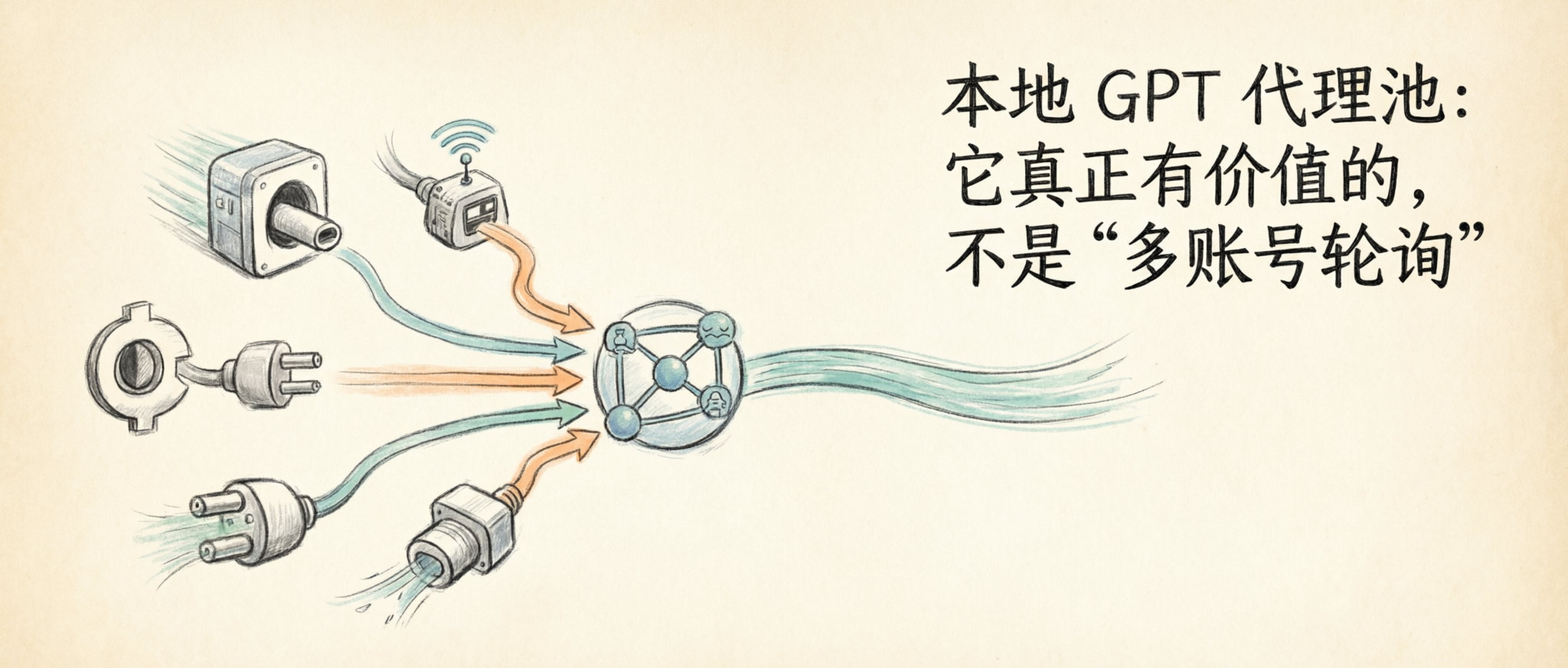

如果只看表面,这像是在讲一个“3 分钟就能搭起来”的小技巧;但我觉得它真正值得聊的,不是教程本身,而是它背后的工程思路:当模型入口越来越多、账号形态越来越杂时,真正有价值的事情,不是再开一个入口,而是把这些入口组织成一个稳定可控的能力层。

很多人会把“代理池”理解成简单轮询,甚至直接联想到“中转站”。但对个人开发者或者小团队来说,更实际的意义其实是:把分散、零碎、时好时坏的模型访问能力,重新收束成一个本地可控的统一出口。

为什么这个思路会打动人

原因其实很现实。

今天很多人手里不只一个 AI 入口:

- 有的是网页版订阅

- 有的是 CLI 工具附带的额度

- 有的是不同模型产品的 Pro / Plus 账号

- 有的是团队里偶尔空闲的订阅资源

这些能力单独看都能用,但一旦进入真实工作流,问题就来了:

- 某个入口今天快、明天慢

- 某个账号今天额度吃满、明天恢复

- 不同工具对接不同账号,切换成本很高

- 自动化脚本、Agent、CLI 工具很难优雅地共用这些入口

所以“本地代理池”这个思路吸引人的地方,不是它神奇,而是它解决了一个很朴素的问题:

怎么把原本分散的 AI 访问方式,变成一个可复用、可切换、可容灾的统一接口。

这才是它真正的价值。

它本质上在做什么

从原理上看,这类方案其实不复杂。

大致就是:

客户端 / Agent / CLI -> 本地代理层 -> 多个上游模型账号或入口

代理层负责的事情一般包括:

- 统一请求入口

- 选择可用上游

- 失败重试或切换

- 对不同客户端屏蔽上游差异

- 在本地保留一定的可观测性和控制权

如果你把它放到传统工程语境里理解,它一点也不新。

它更像是一个很轻量的:

- gateway

- router

- load balancer

- provider abstraction layer

只是这一次,被组织的对象不再是数据库、副本节点或者微服务,而是模型能力入口。

所以它吸引人的地方,不是“代理”这两个字,而是它把 AI 使用方式往工程化推了一步。

真正适合它的,不是“薅”,而是工作流

我对这类方案最强烈的一个判断是:

它更适合工作流,而不是炫技。

如果只是手动打开网页聊几句,其实没有必要给自己再加一层代理。增加一层,就多一层故障点。

但一旦你进入下面这些场景,这一层就开始有意义了:

1. 你在跑长任务

比如 Codex、Hermes、OpenClaw 这类 Agent 或 CLI 工具,一旦进入长任务、批量任务或者自动化任务,对稳定入口的依赖会明显提高。

这时候,代理池的价值不是“更酷”,而是:

- 某个上游挂了,不至于整个任务直接断掉

- 某个账号额度满了,可以切到另一个入口

- 同一个本地地址可以服务多个自动化流程

2. 你有多个模型入口,但不想频繁切配置

这是最常见的真实需求。

你可能同时有网页端、CLI 端、不同 provider 的 key、不同工具自己的认证方式。最烦的不是没有入口,而是入口太多,且每个入口都要手工维护。

本地代理层的价值,是把这些复杂度折叠掉,让上层工具只认一个接口。

3. 你开始把 AI 当成基础设施,而不是玩具

一旦你开始把 AI 放进自己的日常开发流,比如:

- 代码生成

- 批量摘要

- 文档整理

- PR review

- 研究和信息检索

你会越来越在意三件事:

- 稳定性

- 可切换性

- 可控性

而代理池,本质上就是在补这三点。

但它也有非常明确的边界

这里我想把话说得更直接一点:

本地 GPT 代理池是个好思路,但别把它误解成长期稳固、无成本、无风险的万能基础设施。

它至少有四个绕不过去的问题。

1. 上游始终不是你控制的

你能控制的是本地代理层,但你控制不了上游账号策略、额度策略、风控策略和产品策略。

也就是说,你自己做了一个“稳定入口”,不代表上游真的稳定。

2. 条款和风控风险不能假装不存在

如果这类方案只是用于个人实验、本地开发和内部效率提升,问题还相对可控。

但如果把它直接理解成“我可以顺手开个公开中转站”,那就很容易踩到条款、账号安全和风控问题。

所以我的建议很明确:

- 个人使用可以研究

- 小范围内部使用要谨慎

- 公开商用中转不要轻易碰

这不是技术问题,是风险问题。

3. 你只是把复杂度换了个位置

很多人以为加了代理层,复杂度就消失了。其实不是。

复杂度只是从“客户端配置很多”变成了:

- 代理层怎么维护

- 错误怎么观测

- 认证怎么保管

- 切换策略怎么定义

- 故障时怎么回退

所以这件事真正适合的是:愿意自己维护一层基础设施的人。

4. 对个人来说,维护成本可能大于收益

如果你只是偶尔用一下 GPT,最便宜的方案往往不是“自己折腾一层代理池”,而是减少入口数量,保留一个最稳的默认路径。

别为了一个看起来很强的架构,把自己变成系统管理员。

我更认同的理解:这是一种“模型编排”的雏形

如果把视角再拉高一点,我觉得“本地 GPT 代理池”最有启发的地方,是它已经有一点模型编排层的味道了。

以前我们讨论模型,大多还停留在“选哪个模型”“用哪个客户端”“买哪个订阅”。

但下一步真正有意思的问题,其实是:

- 不同入口怎么协调

- 不同模型怎么分工

- 不同账号怎么容灾

- 工具层怎么只面向统一接口

一旦进入这个阶段,问题就不再只是“会不会调用模型”,而是“会不会组织模型能力”。

这也是为什么我觉得这条帖子值得写成博客。

它表面上在讲一个几分钟能搭起来的小方案,背后真正值得看的,是一种越来越清晰的趋势:

AI 使用正在从“找一个入口”走向“组织一层能力”。

最后一句

如果你问我,这类本地代理池值不值得折腾,我的答案是:

- 如果你已经有多个 AI 入口,而且在跑真实工作流,值得试

- 如果你只是想跟风搭一个“听起来很厉害”的结构,没必要

它最有价值的地方,从来不是“多账号轮询”这几个字。

而是你开始意识到:真正决定效率上限的,不只是模型本身,而是你有没有把模型能力组织成一个稳定、可复用、可切换的系统。